AI 原生推理雲平台

GMI Cloud 是專為 AI 推理打造的 AI 原生基礎架構平台,從無伺服器 API 到專屬 GPU 與叢集級部署,協助團隊在 NVIDIA GPU 上穩定運行、靈活擴展並加速 AI 落地。

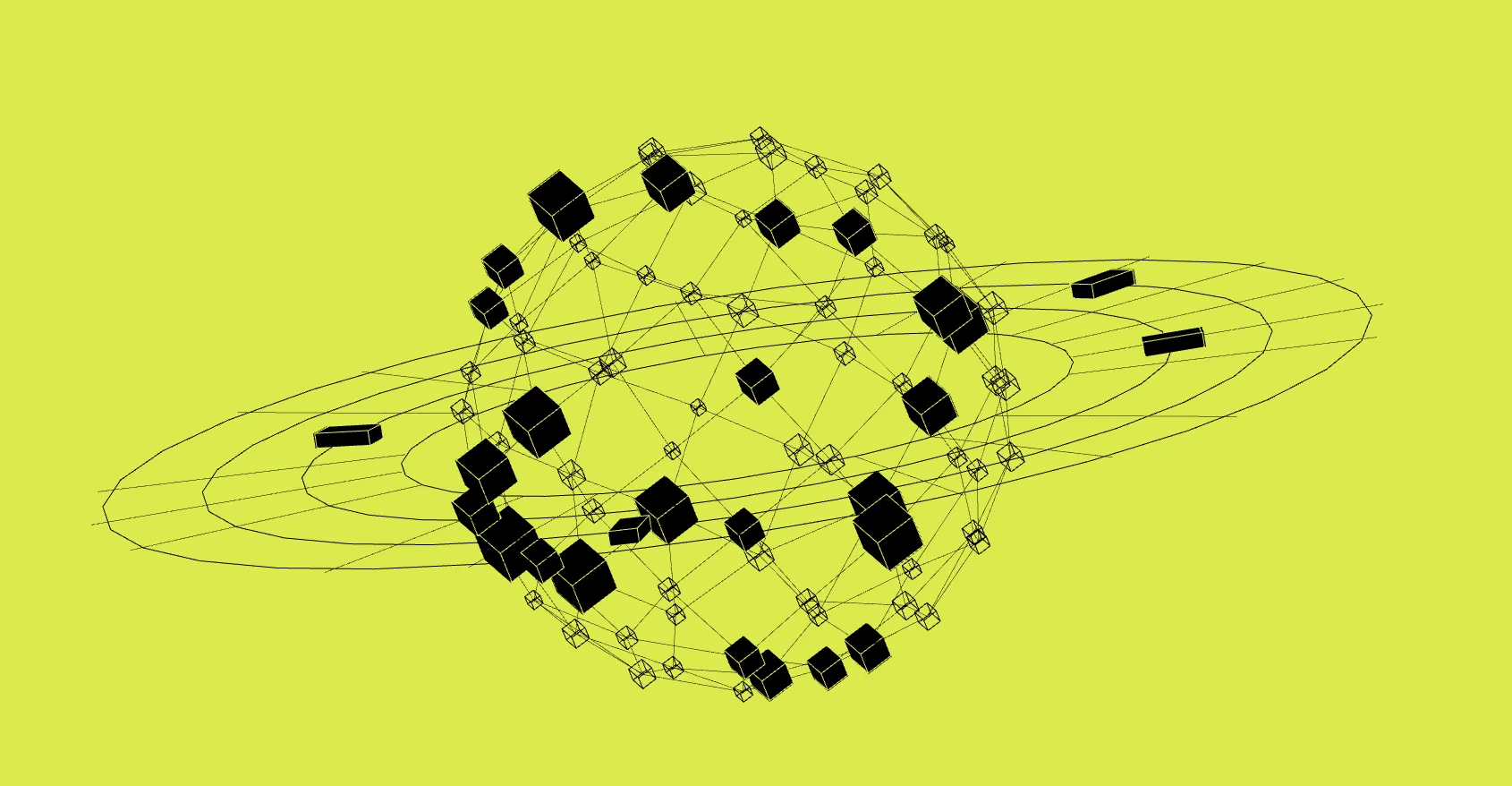

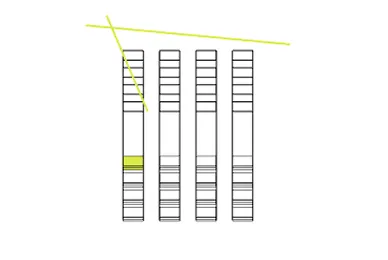

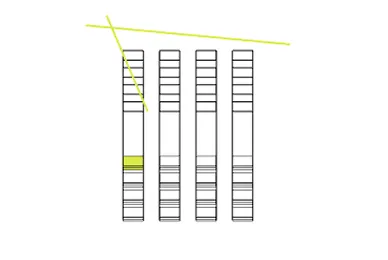

GMI Cloud 全端 AI 基礎架構平台

GMI Cloud 提供垂直整合的 AI 基礎架構堆疊,從推理 API、模型服務到叢集編排與 GPU 運算,支援 AI 工作負載從開發走向規模化部署。

推理層

為低延遲、可預測成本與規模化運行打造的 AI 推理層。

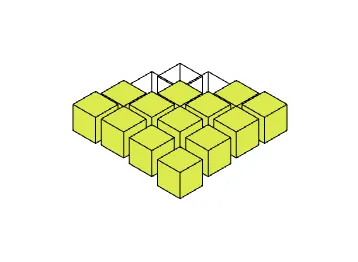

編排層

基於 Kubernetes 的編排平台,支援自動擴展、負載平衡與多區域部署,讓 AI 工作負載更穩定、更易於管理。

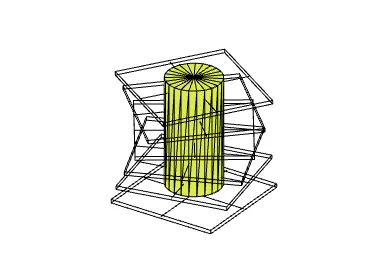

運算層

提供專屬與隨需可用的 NVIDIA GPU 運算資源,支援可擴展的 AI 訓練與推理工作負載。

硬體層

在自有資料中心部署 NVIDIA H100、H200、Blackwell 與次世代 GPU 平台,提供穩定且可擴展的基礎算力。

支撐 AI 規模化運行的基礎實力

AI 規模化推理需要的不只是算力,更需要穩定效能、可預測成本與可持續營運的基礎架構。

已部署 GPU

30,000+

平台可用性

99.99%

策略合作關係

NVIDIA Reference Architecture

雲端平台合作夥伴

AI 團隊客戶

300+

GPU 效率提升

最高 3.7 倍

支援 AI 規模化運行的團隊

GMI Cloud 提供多元 NVIDIA GPU 架構與部署選項,靈活支援從開發到規模化運行的各類 AI 工作負載。

AI 開發者與工程師

以直覺化 API 與 SDK 快速啟用 AI 推理,在可擴展的 NVIDIA GPU 基礎架構上完成開發、測試與部署。

企業 AI 團隊

以具備 SLA 效能保障、SOC 2 與 ISO 27001 合規認證的專屬 NVIDIA GPU 基礎架構,支援企業部署關鍵任務 AI 系統。

GMI Cloud AI 生態系

橫跨美國、歐洲與亞太的全球 GPU 區域布局,支援 AI 工作負載穩定部署與規模化運行。

GLOBAL_REACH

涵蓋北美、歐洲與亞太的 GPU 區域布局

PERFORMANCE

跨區部署,平均回應低於 200 毫秒(約 0.2 秒)

PARTNERSHIP

NVIDIA Reference Architecture 供應商

SUPPORT

24/7 全天候營運與全球技術支援

INTEGRATION

領先模型供應商與 MLOps

全球 AI 團隊信賴的基礎架構夥伴

數百家企業選擇 GMI Cloud,支援 AI 推理、模型訓練與規模化 GPU 基礎架構部署。