趨勢科技使用 GMI Cloud GPU 叢集,以更具成本效益的基礎設施,取代原本在 Oracle Cloud 上運行的 AI 密集工作負載。

- 取代成本較高的 Oracle GPU 基礎設施

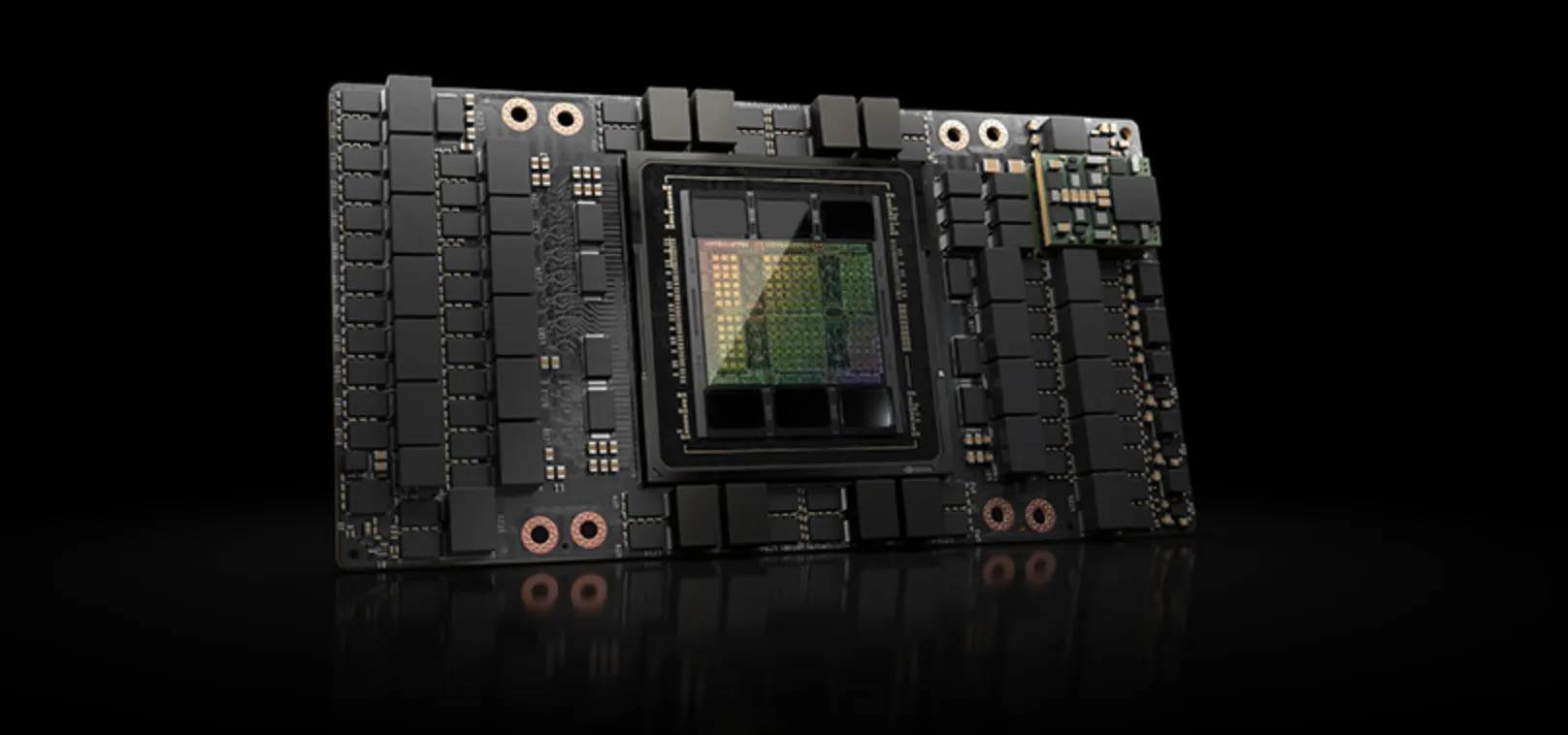

- 已使用 H100 與 H200 GPU 容量

- 更適合 GPU 密集工作負載

- 未來硬體升級路徑涵蓋 GB300

在 NVIDIA H100、H200、Blackwell 與 Vera Rubin 平台上部署 AI 訓練與高效能推理,支援從即時推理到大規模模型訓練的可擴展基礎架構。

支援裸金屬伺服器與容器化部署

完整掌控 GPU 叢集與執行環境

可在 GMI Cloud 平台與私有環境之間彈性擴展

在 GMI Cloud 營運的資料中心內,於專屬 NVIDIA GPU 平台上部署與執行規模化 AI 工作負載,針對穩定效能與高吞吐需求最佳化。

兼顧 AI 訓練與規模化推理的均衡效能

針對多用途 AI 工作負載最佳化

在持續高流量下維持穩定延遲

適合規模化 LLM 與多模態推理部署

專為大規模 LLM 工作負載打造的高記憶體 GPU

更大記憶體容量,適合長上下文模型

針對大批次推理最佳化

可穩定支援規模化部署

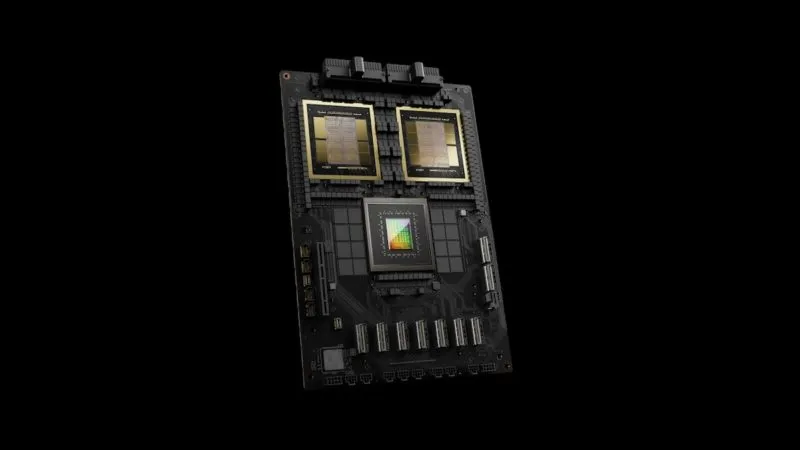

專為高密度 AI 叢集打造的新一代 NVIDIA 架構

為新一代訓練與推理打造

更高每瓦效能

適合分散式叢集部署

適合多 GPU 分散式 AI 系統

高頻寬互連,適合叢集型 AI 工作負載

適合前沿 AI 模型訓練與進階推理

適合長上下文與高參數模型訓練

專為新一代多節點 AI 叢集打造

適合大規模推理與高密度 AI 系統部署

透過針對 GPU 最佳化的容器環境,快速部署具彈性的 AI 工作負載

快速原型開發與模型驗證

彈性推理工作負載

內部 AI 服務與資料處理流程

快速啟動

彈性擴展

基於 Kubernetes 的 GPU 執行環境

專屬實體伺服器部署,提供最高效能、完整掌控與穩定可預期的 GPU 資源。

大規模模型訓練與微調

長時間、高使用率 GPU 工作負載

對效能要求極高的 AI 推理

完整 root 權限與硬體層控制

隔離式、可預期的 GPU 效能

隨需啟用與快速部署

企業級網路與 SLA 服務保障

支援 BYOS 與雲原生部署模式,無論部署架構如何,都能提供一致效能、企業級安全性與穩定的營運保障。

橫跨美國、APAC 與歐洲的多區域部署

支援 RDMA 的高效能網路架構

隔離式 VPC 網路與企業級安全性

SLA 支援的服務交付

最新世代 GPU 平台

Cluster Engine 可作為獨立的 GPU 基礎架構平台使用,也可作為 GMI Cloud 推理與訓練服務的底層核心,讓團隊在同一平台上持續擴展 AI 基礎設施。

探索推理引擎趨勢科技使用 GMI Cloud GPU 叢集,以更具成本效益的基礎設施,取代原本在 Oracle Cloud 上運行的 AI 密集工作負載。

Mirelo AI 使用 GMI Cloud 的專屬 GPU 基礎設施,以更低成本、更快迭代速度訓練基礎模型,並享有彈性商業條款。

Magna AI 與 GMI Cloud 合作,以專為受控環境設計的基礎設施,支援主權 AI 與政府導向的部署場景。

快速解決您的疑問:從技術細節到帳務方案,全面支援。