AIネイティブ推論クラウド

GMI Cloudは本番AI推論のために構築されたAIネイティブインフラプラットフォームです。サーバーレスAPIから専用GPUクラスターまで、NVIDIA GPUプラットフォーム上で予測可能なパフォーマンス、スケーラブルなキャパシティ、コスト効率の高い実行を提供します。

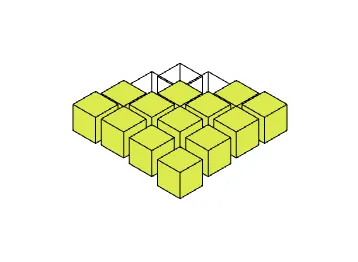

GMI Cloudフルスタックプラットフォーム

GMI Cloudは推論APIとオーケストレーションからコンピューティングとハードウェアまで、垂直統合されたAIインフラスタックを提供します。

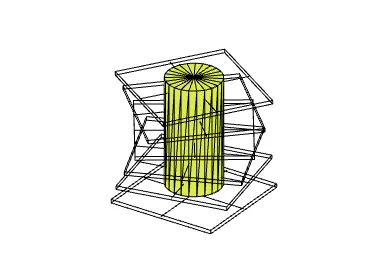

推論レイヤー

低レイテンシと予測可能なコストに最適化された本番グレードのAI推論。

オーケストレーションレイヤー

自動スケーリング、ロードバランシング、マルチリージョンデプロイを備えたKubernetesベースのプラットフォーム

コンピューティングレイヤー

スケーラブルなAIワークロード向けの専用およびオンデマンドNVIDIA GPUコンピューティング。

ハードウェアレイヤー

自社データセンターのNVIDIA H100、H200、Blackwellおよび次世代GPUプラットフォーム。

本番推論になぜフルスタックインフラが重要なのか

本番推論ワークロードには、一貫したパフォーマンス、予測可能なコスト、運用信頼性を提供するインフラが必要です。

デプロイ済みGPU

30,000+

プラットフォーム可用性

99.99%

戦略的アライアンス

NVIDIA Reference Architecture

Cloud Platform Partner

AIチーム顧客

300+

GPU効率向上

最大3.7倍

本番AIを運用するチームをサポート

GMI Cloudは、カスタマイズされたNVIDIA GPUインフラとデプロイモデルで3つの本番AIセグメントをサポートしています。

AI開発者&エンジニア

直感的なAPIとSDKで本番対応AI推論にアクセス。完全なドキュメントと開発者ツーリングを備えたスケーラブルなNVIDIA GPUインフラで構築、テスト、デプロイ。

エンタープライズAIチーム

SLA保証のパフォーマンス、コンプライアンス認証(SOC 2、ISO 27001)、エンタープライズサポートを備えた専用NVIDIA GPUインフラでミッションクリティカルなAIシステムをデプロイ。

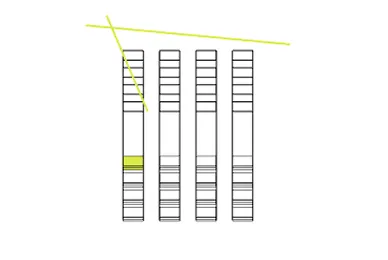

GMI Cloudエコシステム

本番AIデプロイのために構築された、米国、ヨーロッパ、アジア太平洋にまたがるグローバルGPUリージョン。

GLOBAL_REACH

北米、ヨーロッパ、アジア太平洋にまたがるGPUリージョン

PERFORMANCE

クロスリージョン平均レイテンシ< 200 ms

PARTNERSHIP

NVIDIA Reference Architectureプロバイダー

SUPPORT

24時間365日の運用&グローバルサポート

INTEGRATION

主要モデルプロバイダー&MLOps

世界中のAIビルダーに信頼されています

何百もの企業が本番AI推論と大規模GPUインフラでGMI Cloudを信頼しています。

AIネイティブ推論クラウドで構築

最初のAIモデルをプロトタイピングする場合でも、毎日数百万の推論リクエストにスケールする場合でも、GMI Cloudのフルスタックインフラは本番推論ワークロードを支えるパフォーマンス、信頼性、コスト効率を提供します。信頼できるインフラ上でAIの未来を構築する何百ものチームに参加しましょう。